A medida que la inteligencia artificial se integra más en nuestras vidas, la necesidad de una regulación clara y efectiva se hace más evidente. Con la introducción del Reglamento de Inteligencia Artificial (IA) de la Unión Europea, se busca establecer un marco que garantice tanto la innovación como la protección ética de los ciudadanos.

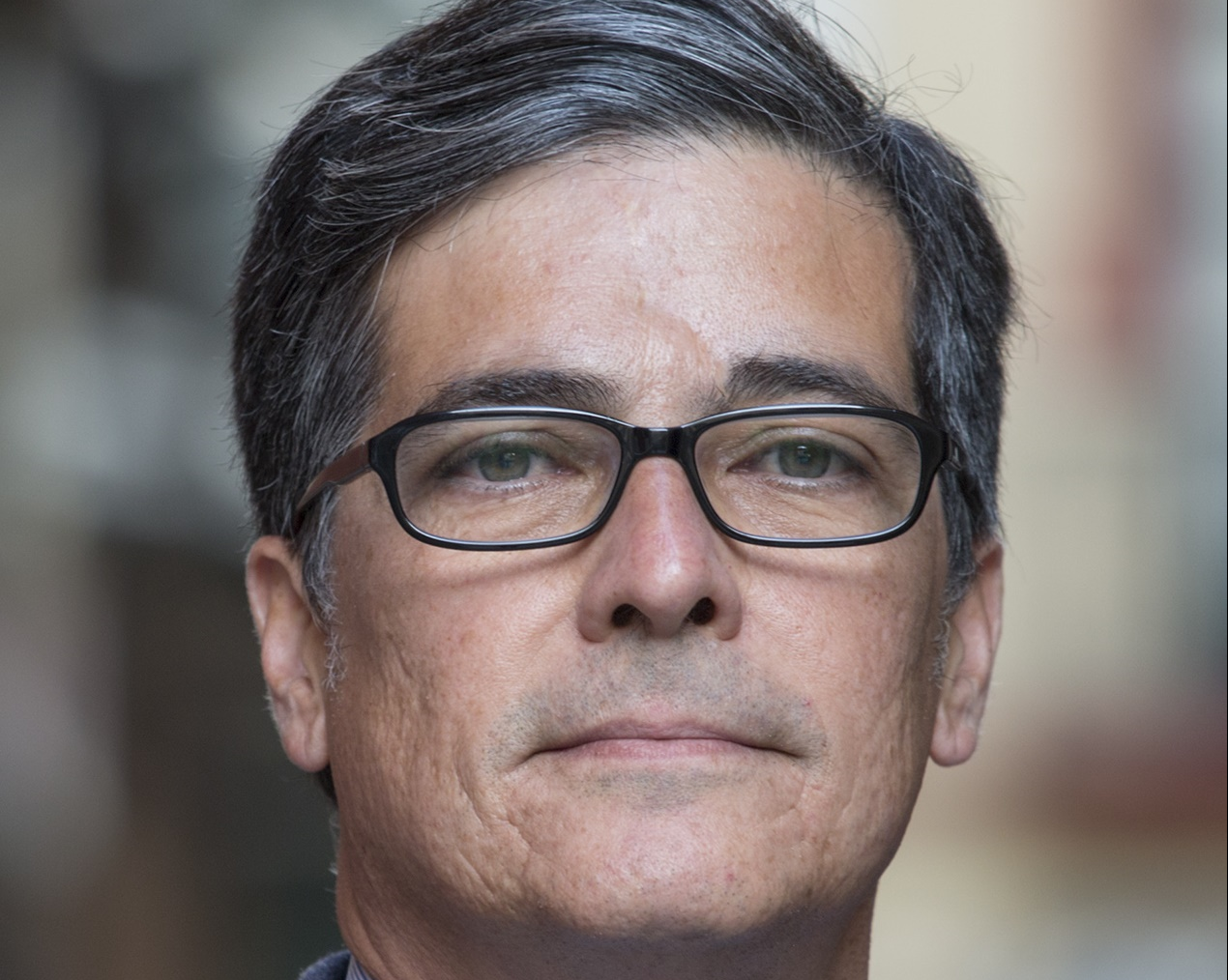

En esta entrevista, Juan Miguel Pulpillo, delegado de protección de datos del Centro de Ciberseguridad Industrial (CCI), desgrana los aspectos más cruciales de la legislación y lo que significa para el futuro de la inteligencia artificial.

¿Qué destacas de la nueva ley de IA?

Cuando se apruebe, se publique y entre en vigor, ya tendremos regulación europea de inteligencia artificial y nos tocará, quizás lo más difícil, centrarnos en la aplicación práctica de esta legislación.

Va a ser la primera ley, tal y como ya ocurrió con el Reglamento General de Protección de Datos (RGPD) respecto a protección de datos, con afán de convertirse en referente del mundo sobre inteligencia artificial, para reducir riesgos, crear oportunidades, combatir la discriminación y aportar transparencia. Prohibiendo en Europa prácticas inaceptables de IA y protegiendo los derechos de los trabajadores y los ciudadanos. En el que se ha vinculado el concepto de inteligencia artificial a los valores fundamentales que constituyen la base de nuestras sociedades.

Igualmente, establece la regulación para la introducción en el mercado, la puesta en servicio y/o la utilización de determinados sistemas de Inteligencia Artificial, para garantizar el buen funcionamiento del mercado interior y permitir que estos sistemas se beneficien del principio de libre circulación de mercancías y servicios.

Veremos su materialización práctica, ya que a fecha de hoy los grandes proveedores de Inteligencia Artificial están fuera de la Unión Europea. Quizás por eso se establece un amplio ámbito de aplicación del reglamento, con independencia de dónde se encuentra el establecimiento de los proveedores y responsables del despliegue de sistemas IA, en la medida que se pretenda que la información de salida generada por dichos sistemas se utilice en la UE.

Con el fin de establecer un conjunto proporcionado y eficaz de normas vinculantes para los sistemas de IA, es preciso aplicar un enfoque basado en los riesgos claramente definido, que adapte el tipo y contenido de las normas a la intensidad y el alcance de los riesgos que puedan generar los sistemas de IA en cuestión.

El nuevo reglamento sigue la sistemática de toda la regulación en materia de ciberseguridad actual, planteando su aplicación en todos los sectores y en consonancia con el actual marco regulatorio, en materia de protección de datos, protección de los consumidores, derechos fundamentales, empleo, protección de los trabajadores y seguridad de los productos. Todo esto, se complementa con los principios éticos de la IA que deben inspirarlo.

Es muy interesante la manera casuística de abordar las clases de IA atendiendo al riesgo y los sistemas de identificación biométrica, encajándola con la regulación de protección de datos.

Resaltar también la importancia que se le da a la alfabetización en materia de Inteligencia Artificial para dotar a los proveedores, responsables de despliegue y personas afectadas de los conceptos necesarios para tomar decisiones con conocimiento de causa en relación con estos sistemas de IA y para que la cadena de valor de la IA adquiera los conocimientos necesarios para garantizar el cumplimiento adecuado y la correcta ejecución.

Nuevamente, se promueve la elaboración de códigos de conducta voluntarios para promover la alfabetización en esta materia entre las personas que se ocupan del desarrollo, el manejo y uso de la IA.

Ante este reto existen dos posibilidades, no solo no excluyentes, sino complementarias: Una, incorporando a los sistemas de construcción de tecnologías IA un conjunto de reglas capaces de ajustar el comportamiento de los productos o servicios IA a las normas ético-legales de aplicación; dos, vía auditoría, que tales tecnologías, productos o servicios son conformes a un modelo o referencia de comportamiento ético-legal previamente definido.

Finalmente, he de destacar que no veo que se aborde el problema de caja negra de algunos algoritmos de IA porque el sistema aprende sobre datos y comportamientos de forma automática y no siguiendo un algoritmo fijo predeterminado.

¿Cómo afectará a las empresas la nueva legislación?

A diferencia de otras tecnologías, los avances en Inteligencia Artificial no requieren provisión de bienes físicos ni el control de las rutas de aprovisionamiento; sí, obviamente, requieren el uso de ordenadores o centros de procesos de datos para ejecutar los algoritmos asociados. De esta manera, un elemento estratégico relevante en la IA es la necesidad de incrementar las necesidades de recursos humanos cualificados.

Ya ha comenzado a sentirse la necesidad del uso intensivo de recursos humanos, y será aún más acuciante en los próximos años, provocando otro tipo de flujo a nivel global: personas altamente capacitadas en las técnicas de IA que ha conducido a una situación de déficit actual en muchos países que puede llegar a ser muy relevante para asegurar el desarrollo en el futuro próximo.

La penetración en la sociedad es imparable con aplicaciones en todos los sectores, aunque, en muchos casos, será invisible para el usuario final, lo que conlleva riesgos al no conocerse la base de la decisión de los algoritmos, situación que obligará a controlar y revisar su uso por parte de las autoridades para evitar sesgos. ¿La solución será la transparencia exigida?

En primer lugar, se deben desarrollar pautas para la seguridad dentro de los sistemas de la IA, es decir, que las empresas identifiquen los efectos de seguridad que tendrá el uso de IA antes de aplicarlos, a fin de tomar las medidas de seguridad apropiadas. El uso de aplicaciones de IA puede abrir vulnerabilidades, particularmente cuando depende de interfaces dentro o entre organizaciones que inadvertidamente crean oportunidades para ataques. Además, los atacantes también empiezan a usar IA porque la tecnología es accesible.

La obligatoriedad del control de revisión y auditoría exige también disponer de mecanismos fiables, capaces de trasladar al diseño y desarrollo de la tecnología IA subyacente a las exigencias legales, éticas y normativas que aseguren que, a la postre, se obtiene un producto adecuado, jurídico y éticamente aceptable.

Además, en nuestra opinión, para que una tecnología, producto o servicio IA pueda ser usada por sus destinatarios, no es únicamente imprescindible que sea conforme a unos principios éticos o a un ordenamiento jurídico concreto; será necesario, adicionalmente, realizar un análisis de impacto de tal objeto IA sobre la sociedad en la que pretende insertarse.

A la vista de la complejidad para trasladar los principios éticos y legales a la tecnología IA (y, en su consecuencia, a los productos o servicios en los que se incorpora), parece necesario contemplar, complementariamente, un control ex-post, capaz de determinar, con un alto grado de confianza, la bondad de un producto/servicio IA, ya construido, y antes de su comercialización o despliegue.