Los ataques de inyección, el almacenamiento inseguro de datos y la autorización inadecuada son vulnerabilidades clave que pueden identificarse mediante pruebas de penetración

En la era digital actual, los chatbots basados en inteligencia artificial (IA) se han vuelto omnipresentes en aplicaciones web, transformando la interacción entre usuarios y plataformas. Sin embargo, este avance también introduce nuevas vulnerabilidades de seguridad que pueden ser explotadas por actores maliciosos.

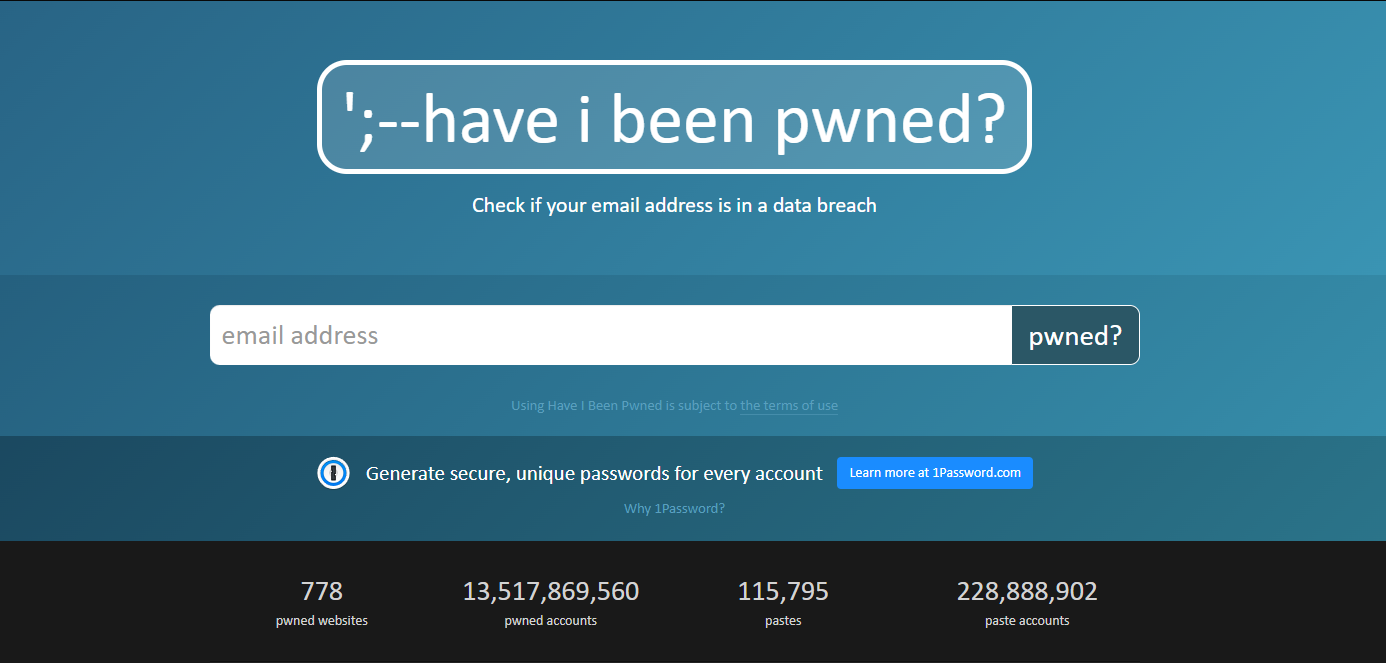

En este sentido, Synack, ha identificado tres vulnerabilidades críticas en los chatbots de IA: ataques de inyección, almacenamiento inseguro de datos y controles de autorización inadecuados.

Ataques de inyección y chatbots de IA

Los ataques de inyección son una amenaza persistente en el ámbito de la ciberseguridad, y los chatbots de IA no son una excepción. Según el informe anual de Synack, estos ataques consisten en la inserción de comandos maliciosos en las entradas del chatbot, explotando vulnerabilidades para manipular el comportamiento del sistema.

Las pruebas de penetración se centran en analizar cómo los chatbots manejan estas entradas, permitiendo a las organizaciones identificar y corregir las debilidades antes de que los cibercriminales las exploten.

Almacenamiento inseguro de datos y riesgos para la privacidad

Asimismo, el estudio de Synack ha señalado que los chatbots de IA a menudo manejan información sensible de los usuarios, lo que hace que el almacenamiento seguro de datos sea una prioridad crítica. Synack ha destacado que el almacenamiento inseguro de datos puede llevar a violaciones de privacidad y accesos no autorizados. Las técnicas de pentesting se utilizan para evaluar los mecanismos de almacenamiento de datos y garantizar su seguridad.

Además, este enfoque no solo reduce los riesgos de privacidad, sino que también asegura el cumplimiento de las directrices de la Open Web Application Security Project (OWASP), que enfatizan la gestión segura de datos. Implementar prácticas de almacenamiento seguro protege la información sensible y fortalece la confianza del usuario en la plataforma.

Autorización y controles de acceso inadecuados

Otra vulnerabilidad significativa que ha identificado Synack es la falta de controles de autorización adecuados. Según el Top 10 de OWASP, la autorización inadecuada puede permitir que usuarios no autorizados accedan y modifiquen funcionalidades del chatbot, lo que podría resultar en el uso indebido de datos confidenciales.

El pentesting evalúa los niveles de acceso y los mecanismos de autenticación, asegurando que solo los usuarios autorizados interactúen con el chatbot.

La importancia del pentesting en chatbots de IA

A medida que las organizaciones integran chatbots de IA en sus aplicaciones web, es vital abordar los problemas de seguridad identificados en la lista de OWASP. De este modo, las pruebas de penetración se destacan como un proceso estratégico para evaluar y fortalecer las funciones de los chatbots de IA.

Por último, Synack ha recalcado que al seguir las directrices de OWASP, las organizaciones pueden mejorar su postura de ciberseguridad y demostrar un compromiso proactivo en la gestión de amenazas emergentes en tecnologías impulsadas por IA.